En los últimos meses el precio de la memoria RAM ha subido en picado, llegando en el mejor de los casos a triplicar el precio de hace unos meses. ¿El supuesto culpable? El acuerdo realizado por OpenAI con SK Hynix y Samsung para quedarse con el 40% de la producción de memoria RAM. Pero, ¿y si todo esto no fuera así y la explicación a la subida de precios venga por otra parte, ¿y si los medios especializados están siguiendo una narrativa construida para mantener artificialmente la burbuja

El proyecto StarGate

Se trata de un megaproyecto para crear no ya un hiperescalador, sino más bien lo que podríamos llamar un ultraescalador con un consumo de 10 Gigavatios y un coste de 500.000 millones de dólares. ¿La fecha de despliegue? El 2029 y detrás del mismo se encontraban empresas como OpenAI, Oracle, NVIDIA y también SoftBank (propietaria actual de ARM). No obstante, no eran las únicas involucradas en el proyecto.

| Socio | Rol | Contribución Financiera |

|---|---|---|

| OpenAI | Liderazgo operativo: diseño técnico, requisitos de carga de trabajo, especificaciones del sitio | Cofinanciador de capital |

| SoftBank | Liderazgo financiero y presidencia: despliegue de capital, desarrollo de sitios en Ohio | Principal financiador de capital |

| Oracle | Desarrollo de centros de datos: construye y opera sitios en Texas, Nuevo México y Wisconsin | Más de 300.000 millones de dólares en 5 años para 4,5 GW (anunciado en julio de 2025) |

| MGX | Financiador de capital | Vehículo soberano de inversión de Abu Dabi |

| NVIDIA | Socio tecnológico: suministra GPUs GB200 y GB300, red InfiniBand | Solo hardware, sin participación accionaria |

| Microsoft | Socio cloud: Azure continúa como computación complementaria | Sin participación en Stargate LLC |

| Cisco | Socio tecnológico: red del sitio en EAU | Sin participación |

¿Su objetivo? la creación de una potente infraestructura capaz de soportar el desarrollo y despliegue masivo de IA, y la reindustrialización de zonas estratégicas a través de la instalación de grandes centros de datos en unos tiempos donde el regionalismo americano está reemplazando el globalismo de años atrás. Sin embargo, si bien el plan inicial era construir el primer StarGate en Abilene (Texas), la idea era llevar el proyecto a otros estados e incluso más allá, llegandose incluso a firmar el despliegue en otras zonas del mundo.

El divorcio entre OpenAI y Oracle

El plan no es un solo centro de datos masivo, sino varios. Siendo el primero el que tenia que construirse en Texas, pero que OpenAI ha abandonado en el proceso, lo que no significa que los otros centros de datos se encuentren cancelados en su desarrollo. No obstante, esta noticia ha creado una serie de falsedades, especulaciones y rumores que son un sinsentido, más que nada no tienen en cuenta que el quinto socio era el propio estado de Texas, a través de incentivos fiscales. Al final será Microsoft la encargada de llevarse el contrato y de montar allí su infraestructura, tras un desentendimiento entre Oracle y OpenAI..

¿Qué ha ocurrido realmente?

Parte de la respuesta a ello la tenemos en un artículo de CNBC donde explica que de los cuatro socios el que podríamos decir que ha metido la pata es Oracle. En concreto, la parte que más llama poderosamente la atención es la siguiente:

OpenAI ya no planea ampliar su colaboración con Oracle en Abilene, Texas, sede del centro de datos Stargate, porque busca clústeres con unidades de procesamiento gráfico (GPU) de última generación de Nvidia, según una fuente cercana al asunto.

Se prevé que el centro de datos actual de Abilene utilice procesadores Blackwell de NVIDIA, y se estima que la infraestructura no estará operativa hasta dentro de un año. Para entonces, OpenAI espera tener acceso a los chips de última generación de NVIDIA en clústeres más grandes ubicados en otros lugares, indicó la fuente, que solicitó el anonimato por motivos de confidencialidad.

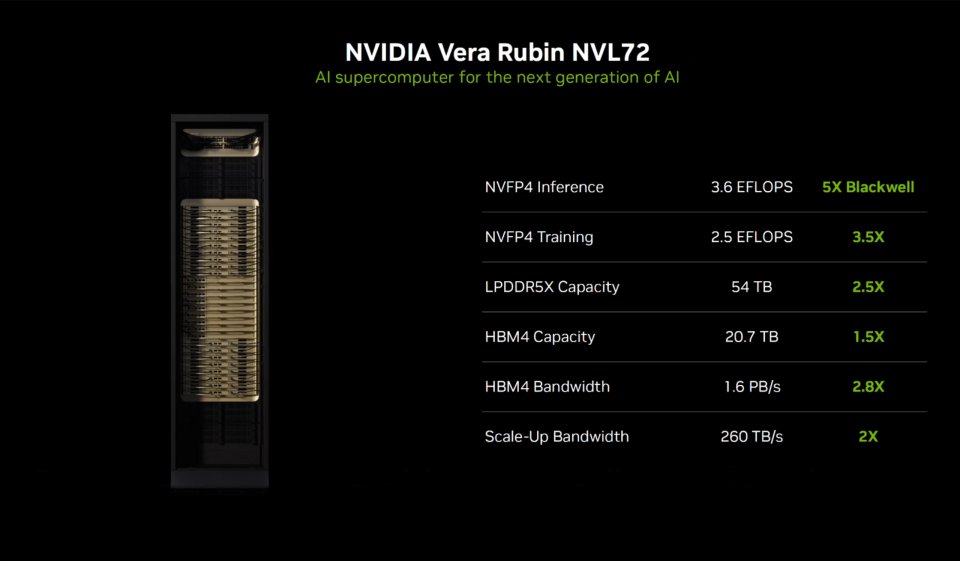

Si bien NVIDIA presentó Rubin al público en el CES de enero de 2026. Obviamente, OpenAI ya conocía de la nueva arquitectura en octubre de 2025, fecha en la que hicieron el acuerdo. ¿El problema con Rubin? Requiere rehacer la infraestructura de nuevo y no puede aprovechar la construida para Blackwell, esto hace que todo el trabajo que había estado haciendo Oracle no sirva para nada. Aparte de usar un tipo de memoria más avanzado, HBM4 en vez de HBM3.

Por lo que la salida de OpenAI del proyecto de Texas no es un paso atrás, sino un salto hacia adelante. Mientras Oracle se ha quedado atrapada en el hormigón y el silicio de 2025 (Blackwell), Sam Altman se adelantó para ejecutar la hoja de ruta de 2027. StarGate no es un edificio; es una estrategia de suministro que ha dejado a Oracle con un centro de datos obsoleto antes de inaugurarse y al mercado de la RAM en un estado de esquizofrenia colectiva.

Rubin es el verdadero motivo

Pues el hecho de que una sola GPU NVIDIA Rubin tiene un TDP de 2300 W de potencia, si bien da un rendimiento en potencia de cálculo 5 veces superior al de Blackwell, esto tiene consecuencias enormes para la infraestructura que estaba montando Oracle. Para meter Rubin en los centros de datos pensados para Blackwell, tendrían que haber demolido parte de la infraestructura de refrigeración líquida para meter tuberías de mayor caudal y presiones que Blackwell no requería.

No es un tema aquí de reducir a la mitad el número de chips, sino que toda la infraestructura ha de funcionar 24/7 y depende de que sea funcional al 100% y todo el rato. Por si fuera poco, el cambio en el tipo de memoria también supone un sobrecoste adicional. Dicho de otra manera, Oracle puso sobre la mesa la capacidad de desplegar un hiperescalador basado en Blackwell a gran velocidad, pensado para GPU con 1200 W de consumo, NVIDIA le ofrecio a Altman el caramelo de Rubin, con hasta 5 veces la capacidad de cálculo y con la nueva HBM4.

El acuerdo de OpenAIcon Samsung y SK Hynix

En medio de toda esta historia relacionada con StarGate esta el despliegue del mismo en otras partes del mundo, entre ellas en Corea del Sur, donde Sam Altman se reunió en persona con los máximos dirigentes de dos de los tres mayores fabricantes de memoria RAM del mundo, Samsung y SK Hynix. Precisamente el acuerdo se llevaba a cabo el 1 de octubre de 2025 y si bien Samsung no era muy concreta de la relación del acuerdo entre las dos partes y el proyecto StarGate, si que lo fue SK Hynix.

Nota de prensa de Samsung

SEÚL, Corea – 1 de octubre de 2025 – OpenAI, Samsung Electronics, Samsung SDS, Samsung C&T y Samsung Heavy Industries anunciaron hoy una carta de intención (LOI, por sus siglas en inglés) para su asociación estratégica con el objetivo de acelerar los avances en la infraestructura global de centros de datos de inteligencia artificial y desarrollar conjuntamente tecnologías futuras en los campos relevantes.

Nota de prensa de SK Hynix

Seúl, 1 de octubre de 2025 — El Grupo SK anunció hoy que el presidente de SK, Chey Tae-won, y el CEO de OpenAI, Sam Altman, se reunieron en la sede de SK en Seúl para firmar una Carta de Intención (LOI) y un Memorando de Entendimiento (MOU) con el objetivo de desarrollar un centro de datos de inteligencia artificial en Corea del Sur como parte del proyecto StarGate.

Cómo se puede ver, en ninguno de los dos casos se habla de un acuerdo del 40% de la producción como se filtró poco después.

El pánico de los fabricantes de memorias

¿Con la crisis de la RAM por qué las grandes empresas no despliegan sus propias fábricas? Hacer una planta de producción de memoria RAM puede costar entre 20.000 y 30.000 millones de dólares para su despliegue y los resultados no son inmediatos. El caso es que hay empresas con un negocio interno tan grande que pueden consumir su propio hardware y hacerlo rentable. ¿El problema? El tiempo de despliegue es contraproducente para el mercado de la RAM, ya que en el tiempo que tarda una fábrica en desplegarse la tecnología ya se ha quedado desfasada.

Esa es la ventaja con la que juegan empresas como SK Hynix y Samsung, no solo se encuentran diseñando la RAM del futuro, sino también la tecnología para fabricarla y el volumen de mercado que tienen en todo el mundo es tan grande que les es suficiente como para mantener los precios sin competencia y poder producir a gran escala. De ahí a que OpenAI prefiera hacer este tipo de acuerdos, ya que la RAM que necesitan para sus sistemas la tienen disponible en menor tiempo del que les costaría desarrollarla.

Teniendo en cuenta que la tecnología en semiconductores avanza a gran escala y quedarse dormido significa perder ventaja significativa en el mercado, este tipo de acuerdos son totalmente normales. Ya lo hemos dicho varias líneas más arriba, OpenAI ha decidido mirar al futuro y esto supone apostar por la memoria HBM4.

La historia de las 900.000 obleas

Resulta que OpenAI le pidio a SK Hynix y a Samsung un total combinado de 900.000 obleas para la fabricación de memoria HBM4, lo cual se tradujo en un acuerdo de 71.000 millones de dólares. Dado que la producción mensual de ambas empresas por separado es menor que esas 900.000 obleas, OpenAI tuvo que pactar con ambas empresas al mismo tiempo, ya que su producción mensual de Samsung es de 680.000 obleas al mes y la de SK Hynix de 620.000 obleas al mes.

Ahora bien, la trampa es que el acuerdo era una carta de intención, un tipo de contrato en el que se anuncia el objetivo de comprar esa cantidad de material al proveedor que lo firma. Por lo que Samsung y SK Hynix están obligados a reservar esa producción. En todo caso, hemos de partir del hecho de que los fabricantes de chips suelen reservar un espacio para el precio por contrato y el precio al momento, siendo los primeros contratos a gran volumen y de largo plazo, mientras que los segundos son chips pedidos al momento.

La consecuencia al movimiento de OpenAI es que de repente el mercado de los módulos DIMM y SO-DIMM para PC se vio afectado negativamente, ya que se quedaron sin la producción y una escasez enorme. Lo normal es que el llamado Spot Price sea mucho más alto que el del Contract Price, llegando en algunos casos incluso a ser varias veces mayor. Precisamente los fabricantes de módulos de memoria compran a medida que tienen demanda y no suelen acumular stock, mientras que los fabricantes y ensambladores de ordenadores compran por contrato.

Poniendo las cifras en contexto

La cantidad de GPU que estaban inicialmente planeadas para el StarGate de Abilene eran 64.000 en total, pero esto fue cuando el chip planeado era el GB200, el cual trae por servidor 36 Blades compuestos por 2 pares de GPU B200 y una CPU Grace. Mientras que la CPU usa memoria LPDDR5X, amas GPU vienen equipadas con 8 pilas de memoria HBM3e, la cual es 12-Hi, lo que significa que cada pila de memoria esta compuesta por 12 chips para una configuración de 192 GB.

Teniendo en cuenta que las malas lenguas hablan de 900.000 obleas en total, la pregunta es. ¿Son necesarias? La idea inicial es un despliegue con 64.000 GPU, esto son en realidad 32.000 placas GB200 y teniendo en cuenta que cada Rack son 72 GPU, si hacemos un redondeo, esto nos da un total de 444 de NVIDIA DGX NVL72, lo que se traduce en 63.936 GPU en total. ¿Por qué hacemos esto? Puro autismo y precisión. El caso es que dicha cifra se convierten en 6.649.344 chips en total, y no, no hemos hecho mal el cálculo, ya que hemos incluido el base die, que se suele olvidar.

- Área por oblea: 70.000 mm cuadrados.

- Área por chip: 121 mm cuadrados.

- Numero de chips completos por oblea: 578

- Número de chips buenos de media teniendo en cuenta los yields (70%): 405 en total.

- Obleas necesarias para la HBM3e de 64.000 GPU B200 de NVIDIA: 16.420

- Obleas necesarias para llegar a las 450.000 GPU planeadas inicialmente: 115.155

Esto esta muy lejos de las 900.000 obleas de las que se hablo inicialmente, pero no es la historia completa. Sin embargo, ¿qué ocurre con la HBM4? Su tamaño es de 12 mm x 10.5 mm y los yields por el momento son del 50%, ya que todavía no han llegado a una alta eficiencia a la hora de fabricar este tipo de memoria. Eso sí, la configuración vuelve a ser 8×12, pero hemos de tener de nuevo en cuenta el base die. Pues bien, las obleas pasan a ser un 46% mayores y lo más probable es que vayan bajando con el tiempo a medida que madure la fabricación, por lo que sigue lejos de las 900.000 obleas.

El impacto de la LPDDR5X

No podemos olvidar que cada GB200 trae una CPU NVIDIA Grace que no comparte memoria con la GPU, sino que tiene la suya propia, en total vemos 16 chips de memoria LPDDR5X asignados a cada CPU y en el despliegue inicial tendríamos 31.968 de estas, lo que se traduce en 511.488 chips de memoria LPDDR5X para todo el despliegue inicial. ¿El impacto total? Apenas 325 obleas para el despliegue inicial y 2285 para las cerca de 450.000 GPU, por lo que la afirmación de que StarGate absorbe el 40% de la producción de SK Hynix y Samsung es mentira, las cifras no cuadran para nada.

Si os preguntáis el impacto sobre Vera Rubin, pues usa la misma configuración de memoria, por lo que el impacto es el mismo, por lo que hablamos de 170.000 obleas para memoria para los aproximadamente 450.000 GPU que piensan construir para los diferentes StarGate alredeor del mundo. De nuevo muy lejos de quedarse con el 40% de la producción mensual. No obstante no el único dato que mata el relato.

El Interposer, el mayor cuello de botella al mito

La memoria HBM requiere el uso de un interposer, el cual se trata de un chip de gran tamaño sobre la que va montada tanto la GPU como las pilas de memoria y se encargan de la comunicación entre las diferentes partes. El motivo de hacer esto es que las memorias HBM usan una gran cantidad de pistas de comunicación, 2048 pistas por pila en el caso de la HBM4 y 1024 en generaciones anteriores, lo cual sería muy difícil de llevar a cabo, por no decir imposible, en un PCB normal.

La fabricación de los mismos se realiza en TSMC, ya que los chips de NVIDIA requieren el uso de la tecnología CoWoS, la cual es propiedad de la fundición taiwanesa, y no solo se usan para las GPU de alto rendimiento de NVIDIA, sino que otras marcas son sus clientes, incluida su rival AMD. A todo esto hemos de añadir que OpenAI es un cliente de NVIDIA, por lo que se van a llevar una porción de una porción para StarGate y a los clientes de TSMC no les gusta que se rompan los contratos.

Se dice que el 85% de la cuota de fabricación (60.000 en total) esta ya comprometida, repartiéndose en 50% del total para NVIDIA y 35% para el resto. Lo que supone que en el mejor de los casos no podrán desplegar más de 30.000 GPU en un mes. Por lo que con estos datos todo el relato queda destruido por completo.

Los medios. influencers y su papel en esta crisis

Los medios especializados son los que han vendido el relato del 40% de la producción de SK Hynix y Samsung por parte de OpenAI para el proyecto Stargate. Se trata de los mismos que por corrupción periodística han dejado primero ir la cifra de 900.000 obleas (falsa) y del agobio de producción del 40%, mientras la tienda de la esquina por orden del distribuidor de memoria te triplicaba los precios y le abonaban el precio para crear una escasez.

Todo ello les ha permitido mantener un relato que beneficia a los patrocinadores de dichos medios y han usado la confirmación por consenso para crear una falsa realidad en la que día tras día muchos han llegado a creerse un relato que a la mínima que rascas en él y miras las cifras reales ves que no cuadra. Incluso te han llegado a vender publirreportajes camuflados como periodismo ético en contra de la IA y hemos visto otras marcas como Micron manipulando el mercado sacando su marca Crucial.

Y después de ello nos diran paranoides y nos haran luz de gas de que no hay pruebas. la realidad es que todo esto se sostiene por un acuerdo completo de la cadena, desde el fabricante hasta la tienda. ¿Acaso no quiere nadie cobrar más dinero que antes por un producto? Cualquier subida de precio es bienvenida dentro de la cadena de venta y distribución, no seamos tontos, lo peor es que se han reído en la cara de millones por la simple avaricia y las consecuencias en el mercado de PC, sobre todo en el DIY han sido desastrosas, ya que las ventas de dicho hardware han bajado en picado lo que lleva a subidas de precio generalizadas. Al menos nosotros tenemos la mente tranquila, nos podéis creer o no, y entendemos que os sea confuso, nosotros también nos tragamos el relato.